导读

以下内容由 VIPSTAR 结合 X / 社交媒体公开内容 整理,仅作阅读与研究参考。

重点

- 人文工作者没有创造世界变化,但他们却在承受世界变化。

- 有的时候我感觉,那些卖人工智能教程的号总是把 AI 当成一种魔法:给你一个神奇的 prompt,你就能做任何事儿。现…

备注

涉及规则、收益或判断的部分,请以 MasterPa 的原始表达与最新官方信息为准。

人文工作者没有创造世界变化,但他们却在承受世界变化。

有的时候我感觉,那些卖人工智能教程的号总是把 AI 当成一种魔法:给你一个神奇的 prompt,你就能做任何事儿。现实当然不是这样。过去的一段时间里,因为创立了 FUNES, 我们必须每天大量的通过 AI 进行生产。加之还有《蜉蝣天地》、我自己的写作等内容生产,光靠人力已经不够了。所以我们大量的尝试如何使用 AI 辅助我们的内容市场与人文学科研究工作。

后来公司有新同事入职,我就做了个简单的 Keynote。又一次得到的贾行家老师听说后,就邀请我去做个分享。我和合伙人可达给这个分享起名《给人文工作者的 AI 使用指南》。当时是纯私下的分享,主要是一些大方向上的原则。后来又做过几次,逐渐扩充。

不过这个分享一直没公开做过,正好今年和重轻启动了《诗梳风》这档节目,所以第一次完整公开的聊了一遍。以下文字整理自播客《给人文工作者的 AI 使用指南》,AI 辅助整理,有所缩略。如果你想知道完整版,可以官网直接收听,或者在宇宙、苹果播客搜索《诗梳风》即可收听。

过去一年多里,把这套怎么用 AI 的经验讲给过很多做内容、做研究、做知识产品的朋友。它的目标不是教你背几个神奇提示词,更不是把 AI 当成灵丹妙药;相反,它更像是一套工作方法:让你在不写代码的前提下,把大模型真正接进自己的写作、研究、编辑、选题、资料整理与生产流程里,并且做到可追溯、可监督、可验证,最后你依然愿意在作品上署名。

这套方法来自我们在真实项目里踩过的坑:当内容进入规模化生产,纯靠人力会崩;而 AI 直接写一篇又会幻觉、会偷懒、会写得像 AI。于是我们不得不把创作变成产线,把产线变成可迭代的系统。

当今天我不想直接给你各种提示词,我希望能给你一些关键的指导思想和原则。

写在原则之前:这份指南的三条底线

在具体方法之前,先明确三条底线。它们决定了你“怎么用 AI”,也决定了你“为什么要这样用”。

1. 过程必须可追溯、可监督、可验证

你不能只要一个结果、不要过程。对人文工作而言,黑箱最危险:幻觉、错引、偷换概念,都会在黑箱里悄悄发生。

1. 必须可操纵

你要能控制它怎么做、按什么标准做、在哪些地方慢一点、在哪些地方严一点。你不是在“抽卡”,你是在生产。

1. 最后你依然愿意署名

「我愿不愿意把名字放上去?」是最终质检。如果你不愿意署名,通常不是道德问题,而是过程里你的意志没有贯彻进去——也就意味着质量不可控。

原则 0:别对 AI 许愿,把它当作工作台

很多人用 AI 的方式,本质是在许愿:

“给我一个好段子”“帮我写一篇好文章”“解释这篇论文”。

问题在于——“解释”本身就有无数种解释:给外行、给本科生、给研究生、给同行,完全不是一个任务。AI 不可能默认知道你的背景、目的、口味和标准。你不说清楚,它就只能用“平均人类”的默认方式糊一份最省力的答案给你。

把大模型当工作台,意味着:你不向它索要结果,而是调动它的工具来完成一个过程。你要做的是把任务说清楚、把标准说清楚、把步骤安排出来。

比如让 AI 解释论文

你可以像这样把许愿式请求(给我解释这篇论文)改成工作台式任务:

- 明确目标受众:聪明、有好奇心,但不是该领域专家的研究生

- 明确讲解方式:启发式、循序渐进、有学术严谨性

- 明确结构要求:先讲意义,再补背景,再还原研究历程,再讲关键技术点,再提启示

- 明确语气:尊重智力、不居高临下、不假装对方已有深厚基础

你会发现:你给得越像“作业要求”,AI 就越不像 AI,越像一个真的会干活的助教。

原则 1:想要 AI 做好,先反思自己——你才是负责人

如果你雇了一个秘书,你不会只说:

“把汉洋那篇写美国锈带的文章改好。”

你一定会补充:

这篇文章为什么写、写给谁、现在卡在哪、你希望它解决什么问题、哪些地方不能动、你要什么风格、你最在意的指标是什么。

AI 也是一样。你要把它当成一个非常勤奋、非常礼貌、但不懂你脑内隐含前提的同事。真正的“提示词工程”不是技巧,而是一种责任感:任何任务仍然是你在做,AI 只是帮你干活。

当你对 AI 的输出不满意,最有效的第一反应不是“AI 不行”,而是:

- 我有没有说清楚“对象/受众/目的”?

- 我有没有提供足够的背景材料和约束?

- 我有没有把“抽象愿望”拆成“可执行动作”?

- 我有没有给到可判断对错的标准?

原则 2:同一个问题至少问 3 个模型——每个 AI 都有“性格”和擅长领域

在我们公司,任何初次接触大模型的同事我会希望他在前期使用中,每个问题问三个不同的 AI。AI 像人一样有差异:有的更擅长写作遣词,有的更擅长推理解题,有的更擅长代码或工具调用。更现实的一点是:同一家产品的模型、同一个模型的新版本,也会不断微调“风格”和“边界”。

所以一个很朴素但极有效的习惯是:同一个问题,至少抛给 3 个不同 AI,你会快速获得“手感”:

- 哪个更会写、哪个更会想、哪个更会查、哪个更容易偷懒

- 哪些任务适合谁做“第一稿”,哪些适合谁做“审稿人”

- 哪个更适合出“选题/结构”,哪个更适合出“段落/句子”

这一步的价值不在于“选出最强模型”,而在于:你开始像管理团队一样管理模型,而不是把它当唯一神谕。

原则 3:AI 不是全知全能——把它当成“好学校本科生”的常识水平

一个很实用的预期管理是:

AI 的常识水平≈一个 985 的本科生。

如果某件事你觉得“一个优秀本科生都未必知道”,那你就应该默认 AI 也不知道;至少默认它会在不知道的时候“编得很像知道”。

这会带来两个直接动作:

1. 任何超过常识的内容,都要你来教它

比如:你要它写段子、写真正有独特品味的文案、写高度专业的论证——你不能只给一句“写得好点”,你要给范例、给标准、给禁区、给语料。我相信你现在去和朋友解释你心中什么文字是好的,都需要点时间;那怎么能认为 AI 默认知道呢?

1. 你要把它当实习生协作,而不是当神

它能做很多“微观插值”的工作:把你给的脚手架补全,把你给的材料织成可读文本。但“脚手架”和“方向”仍然来自你。

原则 4:让 AI 一步一步逼近目标——白盒分步骤,比黑箱一次性更可靠

AI 的优势不是“直接给你正确答案”,而是它可以在你设计的流程里,稳定完成很多小步骤。你越是要求它“一步到位”,它越容易变成“看似完整、实则偷懒”的黑箱。

一个特别直观的例子是做 TTS(文本转语音)或朗读稿的处理。与其说“注意多音字、不要读错”,不如把任务拆成一串步骤,例如:

- 标出停顿/重音/语速变化的标记

- 识别潜在多音字

- 依据词典或权威读音做核对(必要时先检索再确定)

- 对容易误读但常见的字提前标注

- 实在不行就用同音无歧义字替换,从根上消灭误读可能

这类“显而易见的正确做法”,人类会默认自己会做;但 AI 不会默认。你不把“显而易见”写进流程,它就会在最省力的路径上犯错。

原则 5:先工业化,再 AI 化——你不能从农业时代一步跳到 AI 时代

如果你的写作/研究流程本身是随机的、凭灵感的、资料不管理的,那你确实很难把它交给 AI。因为 AI 只能接住你“可描述、可复现”的那部分。

更现实的路径是:

- 先把工作变成“产线”:可拆分、可复用、可质检

- 再把其中的子步骤交给 AI:让它当工位,而不是当上帝

我们做过一个很笨但很关键的工作:把我自己怎么写一篇非虚构文章的过程解出来。包括:

- 为什么用这个故事开头

- 为什么选这句话

- 如何给例子打分

- 如何起承转合、如何过渡、如何收尾

- 如何把小故事连接到更宏大的图景

最后拆成了几十个步骤,让不同的 AI 只做其中一个步骤。结果是:

不是模型突然变强了,而是流程把它“每次只能行一点点”的能力串起来了。

当你能清晰描述“我的文章是怎么做出来的”,你就会发现:决定质量上限的从来不是“用哪个大模型”,而是你有没有把工作方法讲清楚。

不过这段强烈建议你听节目,说得更详细。

原则 6:预判 AI 会偷懒——它会省算力,你要替它扫清“格式障碍”

AI 会偷懒,而且是“系统性偷懒”:能不打开网页就不打开,能不读 PDF 就不读,能跳过就跳过。不是它坏,而是它在算力与时间的约束下,天然倾向于走最省力路径。

所以你要做的是:把 AI 的算力用在“理解文本”,而不是浪费在“处理格式”。

非常有效的改法包括:

- 尽量把材料转成纯文本/Markdown,再喂给 AI

- 把网页内容复制成干净文本(去掉导航、广告、脚注噪音)

- 对长材料先做“事实提炼/结构提取”,再让它写作

- 把 PDF/EPUB/网页统一入库成可检索的 TXT,再做后续任务

你会发现:很多人抵触这种“体力活”,觉得“机器就该替我干脏活”。但在人机协作里恰恰相反——你愿意做一点点机械劳动,AI 的智力部分才会变得更锋利、更可靠。

原则 7:记住上下文有限——把任务尽量改成“压缩”,不要指望它“凭空扩张”

AI 有上下文窗口,有“记忆上限”。你给它两万字,它未必能记住多少;你给它二十万字,它可能只扫标题。一个形象的类比是:把人关进小房间一天,丢给他一本二十万字的书,出来让他背——能背多少,大概就是 AI 能“记住”的量。

因此有一个很反直觉但极重要的经验:

– 压缩比扩张容易得多

把 100 万字压到 1 万字,往往比把 1 万字扩到 100 万字可靠。

这直接改变你向 AI 提需求的方式:

- 不要用 100 字提示词去要一篇论文

- 相反,把材料尽可能喂进去(分批、检索、RAG 都行),让它在充分材料基础上压缩出结构、观点和正文

你过去写文章、写论文,本来就是“读海量材料→提炼→组织→写作”(至少我是这样)。到了 AI 这里,不要突然双标,要求它凭空生长。

原则 8:克制“我妙手一改就好了”的冲动——改产线,不改结果

很多擅长写作的人,最容易在 AI 面前翻车:

AI 出了个 59 分的稿子,你觉得自己改两下就 80 分,于是你开始改;改着改着变成你重写;重写完你说“还是我自己来吧”,然后从此再也不用 AI。

解决办法不是更努力“改稿”,而是把关注点挪到更上游:

- 不要追求让 AI 直接写出 100 分

- 你的目标是让产线稳定产出 75~80 分

- 你要做的是迭代流程,让“平均分”提高,而不是让“单篇”完美

原则 9:把产线当产品迭代——可靠性本身就是价值

当你有一个系统能稳定给你 70 分的起点,它的价值不是“它像不像你”,而是:

- 你能在接近零成本的情况下拿到一个可用草稿

- 你能把精力集中在更高阶的判断:选题、结构、证据、品味与取舍

你要的不是一个能代替你的全能神,而是一个可靠的工厂:它不完美,但它稳定。

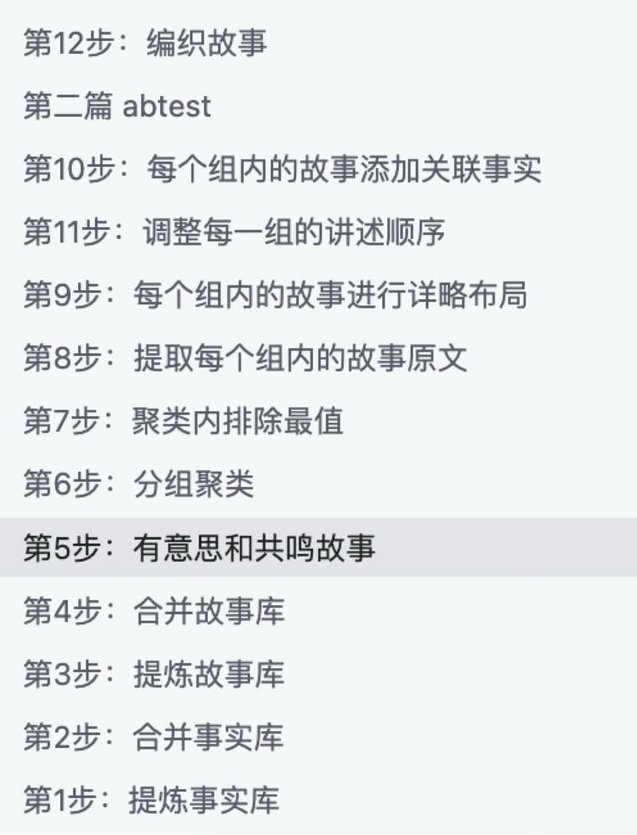

原则 10:数量第一要务——让它多产出,再筛选

只让 AI 给你一个版本,通常会得到最中庸、最保守、最“平均”的那一个。你要用“数量”对抗“平庸”。

更有效的做法是:

- 总结:一次要 5 个版本

- 开头:一次要 5 个开头,做 AB Test

- 选题:一次要 50 个选题,再分组、再挑

- 结构:一次要 3 套结构,再组合

- 表述:一次要 10 个不同措辞,再择优

当你提高平均分、提高产量,分布里自然会出现 85 分、90 分的“惊喜样本”。很多时候,好的不是“那一次神来之笔”,而是你终于开始用统计学的方式工作。

原则 11:别越俎代庖——像行政总厨一样指挥、品尝、让它回炉

如果你是餐厅的行政总厨,你不会亲自去拍黄瓜。你会:

- 尝一口

- 判断是否合格

- 给出明确反馈(哪里不行、要怎么改)

- 让厨师回去重做一遍

与 AI 协作也一样。你要尊重它“按它的方式生成”的主体性——你要做的是教它怎么达到你的标准,而不是自己跳下去把它每次的结果修成成品。

否则你会被无止尽的“修修补补”耗死。

最后一个底层原则:回到真实世界——材料 × 品味,决定作品上限

在 AI 时代,一个作品的质量越来越像是:

材料 × 品味。

模型会变,方法会迭代,但这两件事不变:

1. 材料来自真实世界

如果给你两种选择去写一篇文章:

- 用最新模型,但只能用网上资料

– 用老模型,但你有完整档案、口述史、实地采访

更可能做出好作品的,往往是后者。

1. 品味来自长期训练

当“生成”变得便宜,真正稀缺的是:

- 你知道什么值得写

- 你知道哪些证据更硬

- 你知道哪种叙述更有力量

- 你愿意为材料付出体力劳动:上穷碧落下黄泉,动手动脚翻资料

AI 改变的,是你和材料交互的效率与方式;但作品的主语仍然是你,宾语仍然是材料。AI 只是“动词”的一部分。

结语:把焦虑换成手感

很多人用 AI 用不起来,不是因为不聪明,而是因为一直停留在“许愿—失望—放弃”的循环里。真正能让你跨过去的,是把它当作工作台,把任务工程化,把流程白盒化,然后在不断摩擦里长出手感。

当你能做到这件事,你就不容易草率地下结论“AI 不行”;你会更像一个能管理新工具的新工种:既不俯视它,也不仰视它,把它放在流程里,放在现实里,放在你愿意署名的作品里。

我是汉洋,如果你对我写的文字感兴趣。可以在 X 关注我或者在个人博客查看更多内容。

封面:我拍摄的繁峙公主寺悬塑 📷501cm + E100

编辑评论

这篇《X 导入:MasterPa – 给人文工作者的 AI 使用指南》来自 X 社交平台,作者为 MasterPa。从内容完整度看,原文给出的关键信息密度较高,尤其在核心结论和行动建议上有较强的可执行性。人文工作者没有创造世界变化,但他们却在承受世界变化。 有的时候我感觉,那些卖人工智能教程的号总是把 AI 当成一种魔法:给你一个神奇的 prompt,你就能做任何事儿。现实当然不是这样。过去的一段时间里,因为创立了 FUNES, 我们必须每天大量的通过 AI 进行生产。加之还有《蜉蝣天地》、我自己的写作等内容生产,光靠人力已经不够了。所以我们大量的尝试如何使…。对读者来说,它最直接的价值不是“知道一个新观点”,而是能快速看到该观点背后的条件、边界和潜在代价。 如果把这篇内容拆成可验证的判断,至少包含以下层面:人文工作者没有创造世界变化,但他们却在承受世界变化。;有的时候我感觉,那些卖人工智能教程的号总是把 AI 当成一种魔法:给你一个神奇的 prompt,你就能做任何事儿。现…。这些判断中,结论部分往往最容易传播,但真正决定实用性的,是前提假设是否成立、样本是否足够、时间窗口是否匹配。我们建议读者在引用这类信息时,优先核对数据来源、发布时间和是否存在平台环境差异,避免把“场景化经验”误当作“普遍规律”。 从行业影响角度看,这类内容通常会对产品策略、运营节奏和资源投入产生短期引导作用,尤其在 AI、开发工具、增长和商业化等主题里更明显。站在编辑视角,我们更关注“它是否能经受后续事实检验”:一是结果能否复现,二是方法能否迁移,三是成本是否可承受。来源为 x.com,建议读者将其作为决策输入之一,而不是唯一依据。 最后给出一个实操建议:如果你准备据此行动,可以先做小范围验证,再根据反馈逐步扩大投入;若原文涉及收益、政策、合规或平台规则,请以官方最新公告为准,并保留回滚方案。转载的意义在于提高信息流通效率,但内容价值真正形成于二次判断与本地化实践。基于这一原则,本文配套的编辑评论会持续强调可验证性、边界意识与风险控制,帮助你把“看到的信息”变成“可以落地的认知”。